Mark Zuckerberg ha annunciato con un video pubblicato nel tardo pomeriggio una delle funzioni più attese di sempre per i creator su Instagram e Facebook: l’arrivo della traduzione automatica basata su intelligenza artificiale nei Reels.

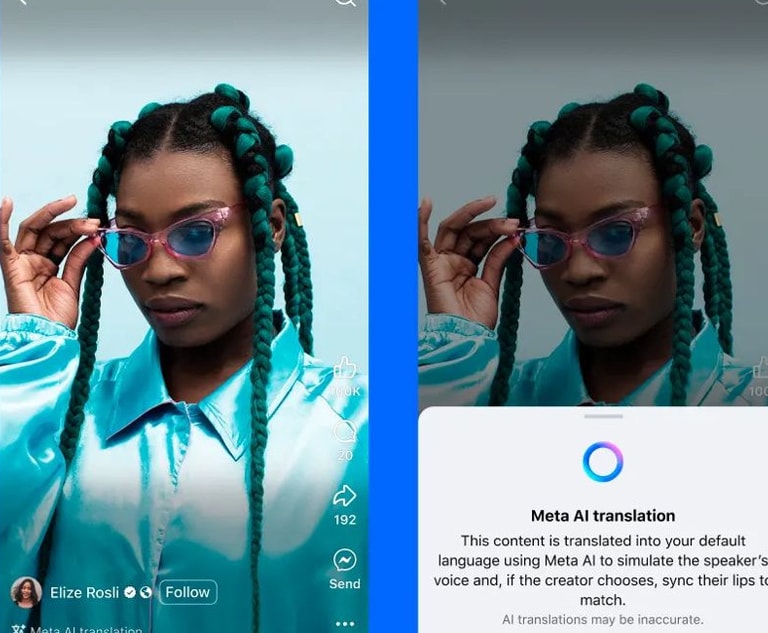

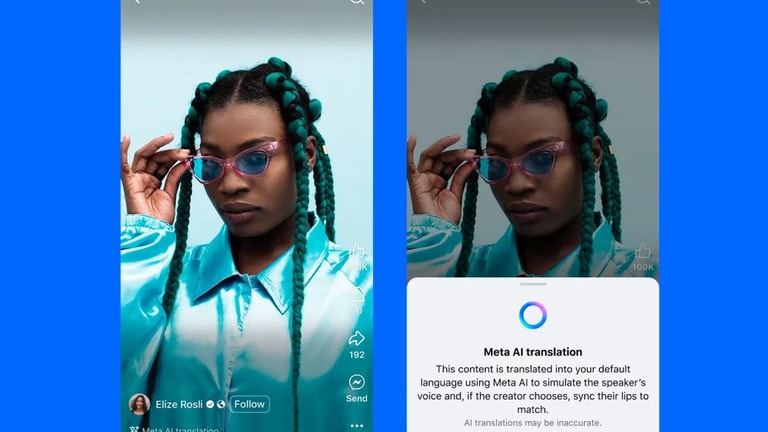

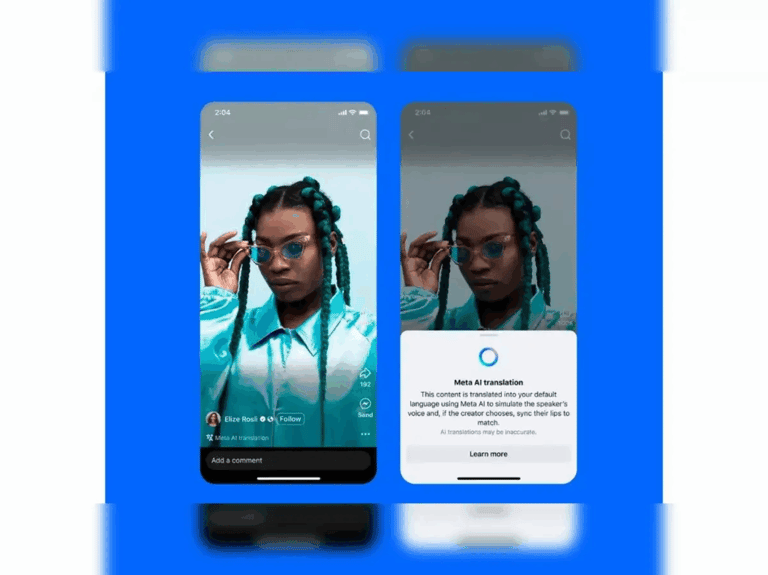

La novità, chiamata Meta AI Translations, permette di doppiare i video brevi in più lingue, mantenendo la voce originale del creator e sincronizzando il labiale per un risultato realistico e naturale.

Nel video di presentazione, Zuckerberg ha mostrato in anteprima come funziona il sistema: grazie a Meta AI, i creator potranno pubblicare i propri Reels in una lingua e farli tradurre automaticamente in un’altra, con un doppiaggio che imita tono, ritmo e stile vocale del parlato originale.

La traduzione non è solo testuale: l’intelligenza artificiale di Meta ricrea una voce sintetica basata sulla voce dell’utente, garantendo un risultato molto credibile e “umanizzato”. Inoltre, la funzione di lip-sync automatico adatta i movimenti delle labbra alla lingua tradotta, rendendo il video coerente anche visivamente.

Dopo una prima fase di test limitata all’inglese e allo spagnolo, Meta ha annunciato l’estensione del servizio a Hindi e Portoghese.

L’obiettivo, come ha spiegato Zuckerberg nel video, è di “rendere i reels davvero globali, accessibili e comprensibili ovunque nel mondo, senza barriere linguistiche“.

Le prossime lingue in arrivo non sono ancora state confermate, ma secondo alcune anticipazioni interne, l’italiano e il francese potrebbero essere tra le prossime ad aggiungersi alla lista.

Al momento, la funzione Meta AI Translations per i Reels è disponibile a tutti gli account pubblici su Instagram e ai creator di Facebook con almeno 1.000 follower o una pagina in modalità professionale. Tuttavia, la distribuzione è graduale e in alcuni Paesi europei (Italia inclusa) potrebbe non essere ancora attiva per tutti gli utenti, a causa di limiti regionali e regolamentari legati all’uso dell’intelligenza artificiale. Non ci resta che attendere: manca poco!